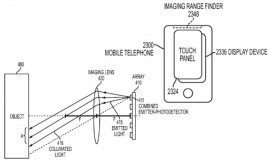

Het is een drukke periode voor Apple op patentgebied: alleen vandaag al werden er patentaanvragen voor een slimme stappenteller en camera-accessoires voor de iPhone openbaar gemaakt. Een nieuw patent ontdekt door Appleinsider laat een mogelijke functie in een toekomstige iPhone zien: een sensor vergelijkbaar met Microsoft’s Kinect. Een camera in de iPhone ziet aan de hand van weerkaatsend licht hoe ver jij en objecten zijn – informatie die apps op slimme wijze kunnen gebruiken.

Het is een drukke periode voor Apple op patentgebied: alleen vandaag al werden er patentaanvragen voor een slimme stappenteller en camera-accessoires voor de iPhone openbaar gemaakt. Een nieuw patent ontdekt door Appleinsider laat een mogelijke functie in een toekomstige iPhone zien: een sensor vergelijkbaar met Microsoft’s Kinect. Een camera in de iPhone ziet aan de hand van weerkaatsend licht hoe ver jij en objecten zijn – informatie die apps op slimme wijze kunnen gebruiken.

Apple heeft al meerdere ideeën voor de Kinect-sensor in de iPhone. Met de speciale camera verandert de iPhone bijvoorbeeld in een nachtkijker – je krijgt dan op het scherm een 3D-rendering van je omgeving te zien. Er is namelijk geen licht nodig om de afstand tussen jou en een voorwerp te bepalen. Een app zou daarom ook in één keer een volledige scan van je kamer kunnen maken.

Apple heeft al meerdere ideeën voor de Kinect-sensor in de iPhone. Met de speciale camera verandert de iPhone bijvoorbeeld in een nachtkijker – je krijgt dan op het scherm een 3D-rendering van je omgeving te zien. Er is namelijk geen licht nodig om de afstand tussen jou en een voorwerp te bepalen. Een app zou daarom ook in één keer een volledige scan van je kamer kunnen maken.

De sensor kan in combinatie met de iPhone-camera worden gebruikt, om beter scherp te stellen op de juiste onderwerpen. De frontcamera van de iPhone kan op deze manier je gezicht van de achtergrond onderscheiden, zodat je omgezet kunt worden naar een 3D-avatar in een game.

De iPhone heeft al een simpele nabijheidssensor, maar deze wordt gebruikt om te zien wanneer je de telefoon tegen je gezicht drukt. Het systeem beschreven in het patent is vele malen geavanceerder. Dat Apple geïnteresseerd is in 3D-sensoren bleek eerder wel: in november 2013 nam Apple de sensorfabrikant PrimeSense over.

Taalfout gezien of andere suggestie hoe we dit artikel kunnen verbeteren? Laat het ons weten!

botst mijns inziens met

Mis ik hier iets? Graag wat verduidelijking.

@EOTB: Ik zou zeggen dat het werkt op het principe van een EDM (elekctomagnetic meassurent dacht ik)

Die werkt niet op basis van weerkaatst licht maar op een weerkaatste EM-golf. Licht is een EM-golf dus ik denk vandaar de verwarring

Die meter zend dus een veranderlijke EM-golf uit welke terug word weerkaatst en opgevangen.

De meter vergelijkt de golfvorm op dat moment en adhv de tijd kan je zo een redelijk getrouwe afstand berekenen

@Senne Vorsselmans: Thanks!