Toegankelijkheidsfuncties in iOS 17: Live spraak, Persoonlijke stem en meer

Apple kondigde eerder dit jaar in het kader van Global Accessibility Awareness Day (18 mei) een reeks nieuwe toegankelijkheidsfuncties voor iOS 17 aan. Het opvallende daarvan is dat ze al bekend werden gemaakt, ruim voordat iOS 17 zelf werd aangekondigd tijdens WWDC 2023. De nieuwe functies zijn breed van insteek: of je nu moeite hebt met spraak, horen, zien of bewegen, er zit voor iedereen wel iets bij. Ook zijn er enkele functies voor mensen die niet kunnen spreken of die het risico lopen hun vermogen om te praten kwijt te raken. Ze zijn mogelijk dankzij verbeteringen in de hard- en software, waaronder machine learning. Ook is er aan privacy gedacht en is er samengewerkt met allerlei belangengroepen. Dit zijn ze!

Hulpbedieningstoegang

Met Hulpbedieningstoegang (Assistive Access) wordt iOS 17 extra simpel gemaakt voor mensen met een cognitieve beperking. Schakel je deze functie in, dan verandert de complete interface van iOS. Je begint op een eenvoudig beginscherm, waarop de appiconen groot zijn afgebeeld. Ook de tekst is duidelijk leesbaar. Hulpbedieningstoegang beperkt veel van de functies van iPhone en iPad.

Er is alleen toegang tot apps die vooraf zijn gekozen, bijvoorbeeld: Muziek, Foto’s, Camera en een gecombineerde app voor telefoon en FaceTime gesprekken. Deze apps zelf zijn ook voorzien van een simpel design. Alleen essentiële functies zijn te gebruiken, zodat de apps zo eenvoudig mogelijk in gebruik zijn. De interface doet ook wel wat denken aan een seniorentelefoon en dat kan ook handig zijn voor wat oudere mensen die moeite hebben met de iPhone bedienen. Lees er meer over in onze tip over Hulpbedieningstoegang.

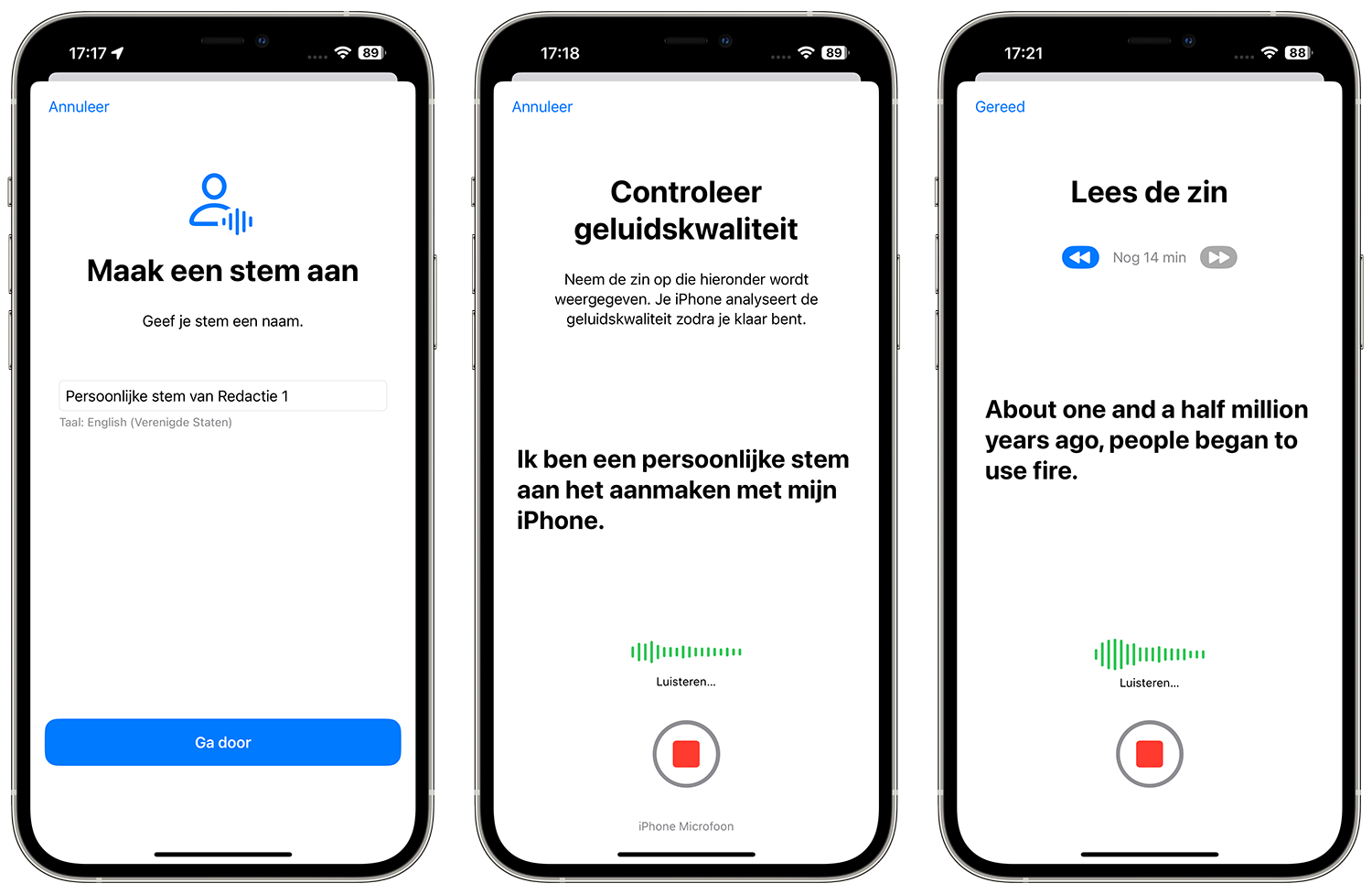

Persoonlijke stem en Live spraak

Voor mensen die hun stem dreigen kwijt te raken is er nu de functie Persoonlijke stem (Personal Voice). Door een kwartier lang zinnen in te spreken leert de iPhone jouw stem kennen. Met behulp van machine learning worden deze opnames omgezet naar een kunstmatige stem, die erg lijkt op jouw eigen stem.

Met Live spraak (Live Voice) kan deze stem worden ingezet tijdens het houden van telefoon- en FaceTime-gesprekken. Je typt zelf in wat er uitgesproken moet worden. Jouw kunstmatige stem spreekt dan deze zin uit.

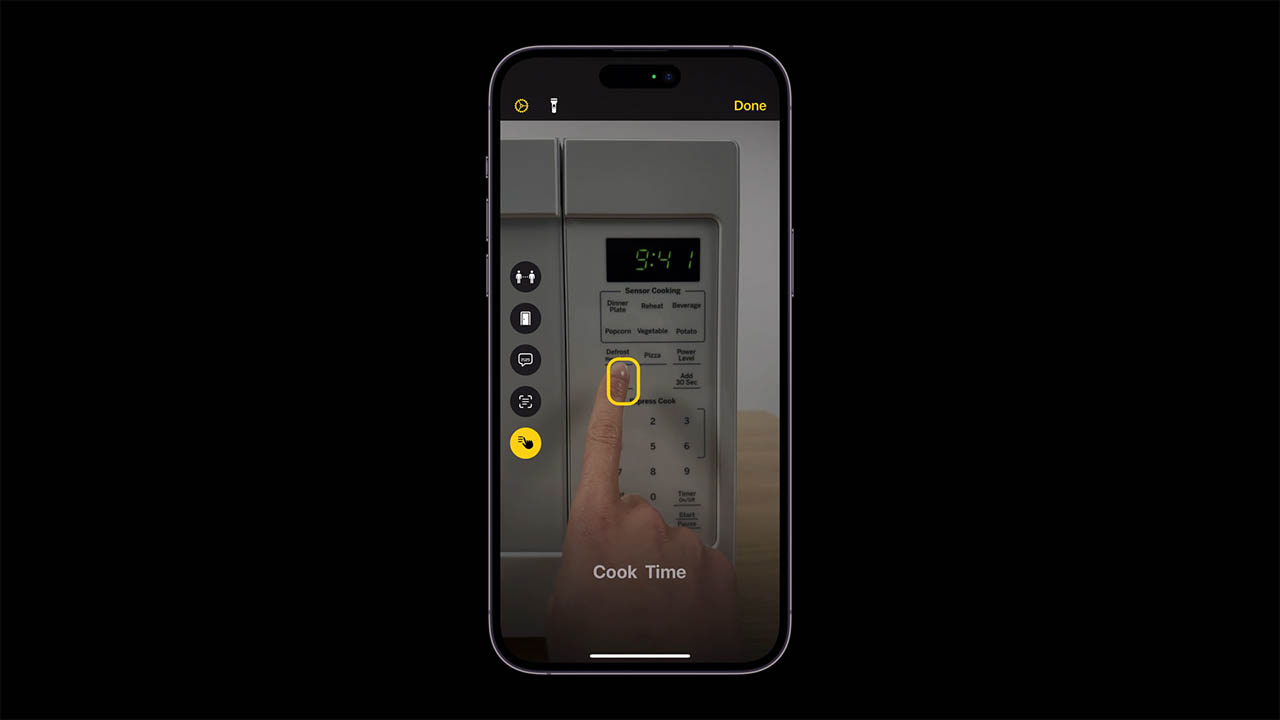

Wijs en spreek

Wanneer je de Vergrootglas-app opent, kan je voortaan gebruik maken van Wijs en spreek (Point en Speak). Je richt de camera op een stuk tekst en brengt je vinger in beeld. De LiDAR-scanner van de iPhone kijkt naar de positie van jouw vinger. Wijs je vervolgens op een letter of woord, dan spreekt de iPhone deze voor je uit. Apple toont een voorbeeld waarbij de functie gebruikt wordt voor het opwarmen van een maaltijd. Hierbij worden de cijfers van de magnetron uitgesproken. Ideaal voor het dagelijks leven!

‘Wijs en spreek’ is speciaal ontwikkeld voor blinden en slechtzienden. Objecten zonder braille zijn niet langer een struikelblok en lost veel lastige situaties op, waarbij je normaal gesproken hulp nodig zou hebben. Denk bijvoorbeeld aan een conservenblik, waarbij je als blinde gebruiker niet kan zien wat erin zit.

Het persbericht over deze nieuwe toegankelijkheidsfuncties in iOS 17 vind je hier. Apple heeft een groot aanbod aan toegankelijkheidsfuncties, die ook nuttig zijn voor mensen zonder een beperking. Probeer ze vooral een keer uit! Misschien zit er wel iets tussen dat het gebruik van jouw iOS device nog leuker maakt!

Taalfout gezien of andere suggestie hoe we dit artikel kunnen verbeteren? Laat het ons weten!

Het laatste nieuws over Apple van iCulture

- Game over voor Mythic Quest: langlopende Apple TV+ serie stopt plotseling (maar met een nieuw einde) (15-04)

- Weekend kijktips: Doctor Who, Friends & Neighbors, Black Mirror en meer (12-04)

- Apple TV+ vanaf nu via Amazon Prime Video af te sluiten in Nederland (met een flinke korting) (09-04)

- Wanneer werkt Apple Intelligence in het Nederlands? Dit is wat we nu weten (07-04)

- Weekend kijktips: Number One on the Call Sheet, Banger, The Operative en meer (05-04)

Very nice!

Maar: “USA only”? We gaan het zien…

Eindelijk de functie waar ik al jaren op zit wachten! AirPods kunnen al jaren naadloos switchen tussen iPhone en MacBook, maar ‘Made for iPhone’ hoorapparaten kunnen tot nu toe alleen rechtstreeks met iOS apparaten koppelen.

Vanaf dit najaar wordt dit zo te zien eindelijk recht getrokken!

Mijn broer is 1 zijdig verlamd geraakt en heeft moeite met typen (gebruikt vooral emoticons) welke functie zou voor hem goed toepasbaar zijn om toch woorden te kunnen typen ? Ik weet het echt niet nl en wellicht kunnen jullie mij daarin helpen om hem wat meer te kunnen laten typen

@Misterx: De app Proloquo2Go van het Nederlandse AssistiveWare staat heel hoog aangeschreven. Zie ons interview.

@Jean-Paul Horn | iCulture.nl: Dankje ga ik die eens downloaden om te kijken of hij hiermee over weg kan