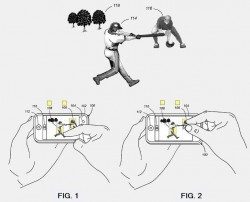

Een nieuw patent van Apple beschrijft hoe de camera van de iPhone op meerdere punten kan scherpstellen. Door op het scherm te tappen en over meerdere onderwerpen te vegen, zou je scherp kunnen stellen op een groter veld. Op het moment kun je alleen eenmaal op het scherm tappen om de camera scherp te stellen.

Een nieuw patent van Apple beschrijft hoe de camera van de iPhone op meerdere punten kan scherpstellen. Door op het scherm te tappen en over meerdere onderwerpen te vegen, zou je scherp kunnen stellen op een groter veld. Op het moment kun je alleen eenmaal op het scherm tappen om de camera scherp te stellen.

Door meerdere scherp te stellen objecten te kiezen, vergroot je de scherptediepte van een foto. Hierdoor heb je meer invloed op wat er scherp op een foto verschijnt. Omdat je op het moment op slechts één onderwerp kunt scherpstellen, komt het namelijk wel eens voor dat er iets onbedoeld wazig wordt.

Het patent werd eind 2010 voor het eerst ingediend door uitvinder Richard Tsai, namens Apple. Op het moment is het slechts een patentapplicatie: hij is nog niet aan Apple toegewezen. Het is daarom nog de vraag of en wanneer Apple er iets mee gaat doen. Daarnaast moeten we zien of Apple de functie in een software-update zal toevoegen, of dat Apple eerst een uitgebreidere camera in de iPhone wil toevoegen.

Meer info: Patently Apple.

Taalfout gezien of andere suggestie hoe we dit artikel kunnen verbeteren? Laat het ons weten!

Dit zou betekenen dat de camera een groter bereik in diafragma zou krijgen of dat de camera misschien wel meerdere foto’s zou gaan kunnen combineren om een beeld te vormen.

Ben heel benieuwd hoe ze dit in de praktijk gaan realiseren. Dat moet haast wel een softwarematig truukje gaan worden. “Scherpstellen” op bijvoorbeeld mijn Canon EOS betekend toch echt dat -of- het onderwerp dichtbij -of- het onderwerp veraf scherp is. Ben niet zo heel echt thuis in technische foto-termen, maar als zowel veraf als dichtbij scherp is krijg je volgens mij gewoon hetzelfde effect als met een pocket-camera waarbij alles scherp is en dan lijkt het me weer zinloos om dit voor verschillende onderwerpen in de foto aan te moeten geven.

Naar mijn weten kan een lens slechts op 1 punt tegelijk scherpstellen. Dit is zo vanaf de simpelste wegwerpcamera tot de duurste hasselblad. Het lijkt me dus onmogelijk dat een iPhone camera op meerdere punten tegelijk kan focussen.

Apple’s manier van denken omvat het denken aan het ondenkbare. Dus ja ik zie het wel gebeuren als de technologie ervoor beschikbaar komt. Alleen niet zo snel natuurlijk.

@Niels.: zie op http://nl.wikipedia.org/wiki/Scherptediepte : je lichtgevoelige materiaal bepaalt wanneer een afbeelding onscherp wordt (= onscherper dan wat dat materiaal maximaal aan scherpte toelaat). Alleen met oneindig kleine pixels zou je dus maar op precies 1 afstand scherp kunnen stellen. Pak je een groter diafragma (lensopening), dan wordt het afstandsgebied waarover het beeld nog scherp is (de scherptediepte dus) kleiner, maar je hebt wel meer licht en dus minder beeldruis. En pak je een telelens (grotere brandpuntsafstand), dan heb je ook een kleinere scherptediepte. Misschien wel bekend van foto’s van b.v. een vogeltje op grote afstand genomen: alleen het vogeltje is scherp. Geeft ook wel een mooi effect.