Alles over Deep Fusion: Apple’s slimme rekentechniek voor nog mooiere foto’s

Deep Fusion en computational photography

Apple voegt elk jaar wel weer iets nieuws toe aan de camera. Sinds 2019 heeft Apple de techniek Deep Fusion. In Apple’s eigen bewoordingen: “Simpel gezegd is Deep Fusion een geavanceerde vorm van computationele fotografie (computational photography), waarbij met behulp van permutaties de best mogelijke foto voor jou wordt uitgekozen.” Dat maakt het niet veel duidelijker. Apple heeft de gewoonte om nieuwe technieken in overdreven bewoordingen uit te leggen. Vandaar dat we op deze pagina uitleggen wat Deep Fusion nou eigenlijk is.

Sinds de iPhone 12-serie is Deep Fusion verder verbeterd. Zo is de techniek beschikbaar op meer lenzen dan voorheen. En met de iPhone SE 2022 is het ook beschikbaar gekomen op een meer betaalbaar model.

- In het kort

- Geschikte toestellen

- Uitleg

- Hoe werkt het?

- Inschakelen

- Deep Fusion-foto’s herkennen

- Nieuw?

- Waarom?

Deep Fusion in het kort

- Deep Fusion werkt alleen op de nieuwste iPhones

- Deep Fusion is sinds iOS 13.2 beschikbaar (oktober 2019)

- Er worden 9 foto’s gemaakt

- Voordat je de sluiterknop drukt maakt de iPhone al 4 foto’s, plus 4 secundaire foto’s

- Druk je op de sluiterknop, dan maakt de iPhone een foto met lange belichting (minder dan 0,5 seconden)

- In een seconde analyseert de neural engine de beelden en kiest op pixelniveau de beste details

- Er worden 24 miljoen pixels geanalyseerd

- Deep Fusion optimaliseert het detail en de mate van ruis in je foto

Wanneer kan ik Deep Fusion gebruiken? Op welke toestellen werkt het?

Deep Fusion is aanwezig sinds iOS 13.2. Om de camerafunctie te kunnen gebruiken heb je één van de nieuwste iPhones nodig, dus:

Op eerdere toestellen is de functie niet aanwezig, omdat de vernieuwde neural engine ontbreekt.

Deep Fusion werkt niet op alle modellen met alle lenzen. In onze tabel zie je precies bij welke lenzen op welke toestellen Deep Fusion ondersteund wordt.

| Groothoek | Ultra-groothoek | Telelens | Selfie | |

|---|---|---|---|---|

| iPhone SE 2022 | ✅ | – | – | ✅ |

| iPhone 13 mini | ✅ | ✅ | – | ✅ |

| iPhone 13 | ✅ | ✅ | – | ✅ |

| iPhone 13 Pro | ✅ | ✅ | ✅ | ✅ |

| iPhone 13 Pro Max | ✅ | ✅ | ✅ | ✅ |

| iPhone 12 mini | ✅ | ✅ | – | ✅ |

| iPhone 12 | ✅ | ✅ | – | ✅ |

| iPhone 12 Pro | ✅ | ✅ | ✅ | ✅ |

| iPhone 12 Pro Max | ✅ | ✅ | ✅ | ✅ |

| iPhone 11 | ✅ | – | – | – |

| iPhone 11 Pro | ✅ | – | ✅ | – |

| iPhone 11 Pro Max | ✅ | – | ✅ | – |

Sinds de iPhone 12 werkt Deep Fusion dus op alle lenzen, ook op de TrueDepth-selfiecamera. De iPhone kiest zelf de juiste instelling zodra je een foto maakt. Dit is mogelijk dankzij de nieuwere chip en de nieuwe Neural Engine. Deep Fusion is daardoor op de nieuwste iPhones ook 80% sneller dan op de iPhone 11-serie.

Wat is Deep Fusion?

Deep Fusion heeft te maken met computational photography. Dit is een ontwikkeling die al een tijdje gaande is. Naast de hardware van een camera spelen softwaretechnieken een steeds belangrijkere rol. Bij computational photography zorgen algoritmes ervoor dat de mooist mogelijke foto wordt gemaakt. Hierbij wordt gemaakt van de image signal processor (ISP) in een camera, een speciale chip die de beelden die met behulp van de sensor(s) en lenzen zijn vastgelegd nader te analyseren. De ISP laat een indrukwekkende reeks wiskundige berekeningen hierop los, om een afbeelding te maken die met alleen optische hulpmiddelen nooit mogelijk was geweest.

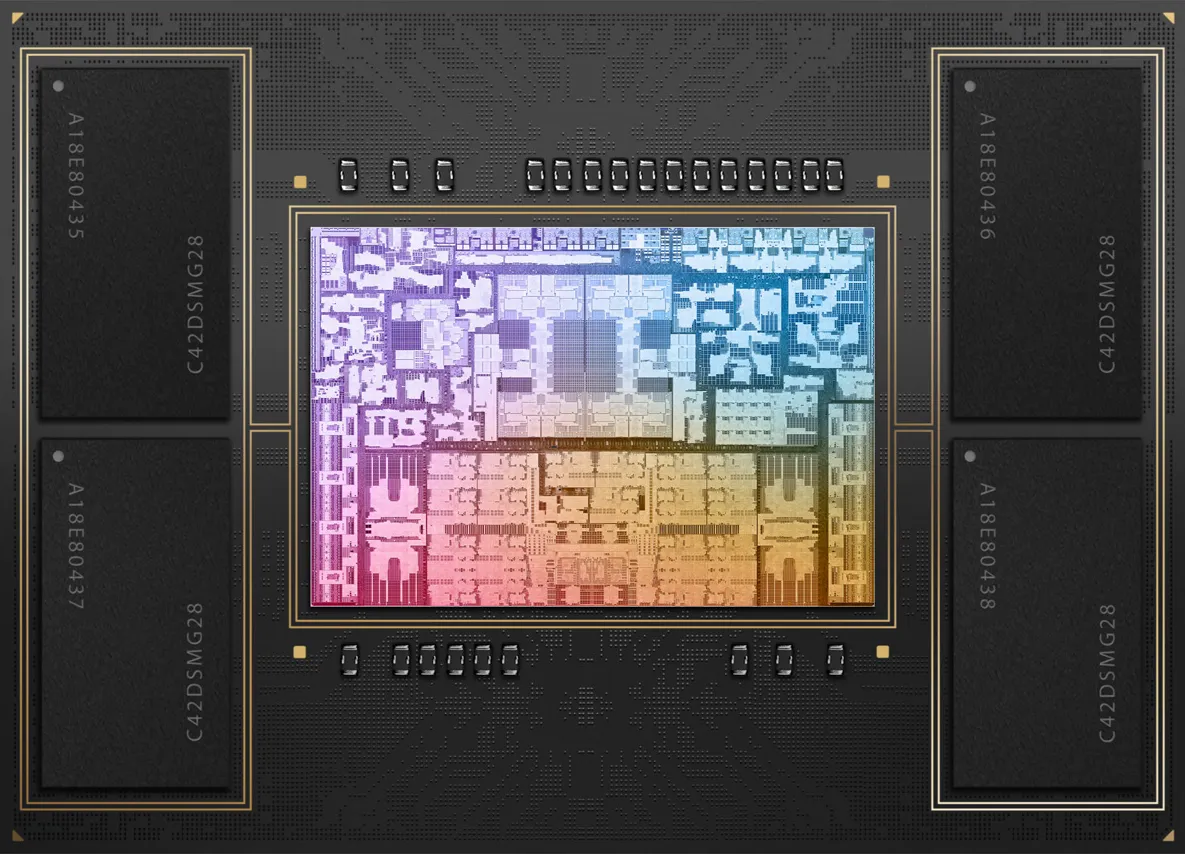

Met Deep Fusion gaat Apple nog een stap verder, wat computational photography betreft. Er wordt niet meer alleen gebruik gemaakt van de ISP, maar een deel van de berekeningen wordt uitgevoerd door de nieuwe neural engine, de Neural Processing Unit (NPU). Daardoor komt er nog meer rekenkracht aan te pas bij het maken van een foto.

Bij het maken van een foto maakt de camera meerdere shots, die met behulp van Deep Fusion worden geanalyseerd. Dit gebeurt pixel voor pixel, waarbij de best mogelijke balans wordt gezocht tussen kleuren, details, witbalans, textuur en ruis. Dit levert een foto op die met alleen fysieke hardware nooit mogelijk was geweest.

Apple demonstreerde Deep Fusion in 2019 met behulp van een foto, waarop een gebreide trui met veel detail te zien is.

Hoe werkt Deep Fusion?

Of Deep Fusion wordt geactiveerd is afhankelijk van de hoeveelheid belichting en lens die je gebruikt op de iPhone:

- De standaard groothoeklens en selfiecamera op iPhone 12-serie en nieuwer gebruikt Apple’s verbeterde Smart HDR voor heldere en gemiddeld verlichte scenes. Bij slechtere verlichting wordt Deep Fusion gebruikt en bij donkere scenes komt de nachtmodus in werking.

- De telefotolens (alleen op de Pro-modellen) gebruikt voornamelijk Deep Fusion, maar bij erg lichte scenes wordt Smart HDR gebruikt. Bij erg duistere scenes is het opnieuw nachtmodus.

- De ultragroothoeklens op de iPhone 11-serie gebruikt alleen Smart HDR. Deze is namelijk niet geschikt voor Deep Fusion en ook niet met de nachtmodus. Sinds de iPhone 12 wordt ook hier Deep Fusion gebruikt.

Op het moment dat je de Camera-app opent, worden een aantal algoritmes aan het werk gezet om het camerasysteem de juiste instructies te geven. De camera bereidt zich voor op het vastleggen van een aantal beelden, die gemaakt worden met alle beschikbare lenzen. Deze beelden worden al gemaakt voordat je daadwerkelijk op de sluiterknop drukt. Besluit je geen foto te maken, dan worden deze tijdelijke beelden weer weggegooid.

Eerste stap: foto maken

Druk je wel op de sluiterknop, dan zorgt de ISP dat er negen foto’s worden gemaakt. Het gaat hier om vier belangrijke foto’s met snelle belichting en vier secundaire foto’s. Daarnaast wordt nog een enkele foto met lange belichtingstijd gemaakt.

De eerste 8 foto’s worden gemaakt voordat je op de sluiterknop drukt. Op het moment dat je de sluiterknop aanraakt maakt de iPhone nog één foto met langere belichting. Het is dus belangrijk dat je je iPhone zo stil mogelijk houdt. De lengte daarvan is minder dan 1/2e of 1/6e van een seconde, dus echt superlang is het niet. Bij het maken van foto’s met nachtmodus moet je je camera soms 2 seconden stil houden, dus veel langer.

Tweede stap: berekeningen door de neural engine

De neural engine kan vervolgens aan de slag. Deze bevindt zich in de A-chip. De neural engine stelt een foto samen van 24 megapixels, oftewel 24 miljoen pixels. Daarbij worden de beste pixels geselecteerd uit de 9 foto’s die zijn gemaakt. Bepaalde secties van een foto zullen ongeveer gelijk zijn, zodat de neural engine iets sneller kan werken.

In iets meer dan 1 seconde is het hele proces gelukt: van het drukken op de sluiterknop tot het bekijken van de foto op het scherm.

Hoe kan ik Deep Fusion inschakelen?

Je hoeft niets te doen om Deep Fusion te activeren op je iPhone. Het enige wat je hoeft te doen is beschikken over de juiste telefoon (uit de iPhone 11-serie of nieuwer) en de juiste software-update. De functie komt automatisch in actie zodra jij een foto maakt en het camerasysteem vindt dat het ingeschakeld moet worden.

Hoe kan ik Deep Fusion-foto’s herkennen?

Het is niet zomaar mogelijk om te zien welke foto’s met Deep Fusion zijn gemaakt. Dit kan alleen met bepaalde apps, bijvoorbeeld Metapho. Deze app kan op basis van de EXIF-data van de flitser herkennen of er sprake is van Deep Fusion.

Is Deep Fusion nieuw?

Deep Fusion is niet helemaal nieuw en is ook niet bedacht door Apple. Eerder bracht Sony al een soortgelijke functie uit op de Sony Xperia Z5. Deze maakte vier foto’s: drie voordat je op de sluiterknop drukte en een vierde daarna. Daarmee werd het mogelijk om mooiere, stabiele foto’s te maken van snelbewegende objecten, zonder dat de foto onscherp werd. Het maken van meerdere foto’s kennen we ook van de Smart HDR-functie, die sinds een aantal jaren in de iPhones zit. Bij Sony werkte het nog niet goed, omdat de interface te traag was en de camera vaak vastliep. Wel liep Sony voorop. Op deze pagina leggen ze uit wat fotograferen met een Xperia Z5 zo bijzonder maakt.

Google ging ook met de functie aan de slag voor de Pixel 3 en introduceerde burstfoto’s voor HDR. Daarmee werden 15 foto’s gemaakt in HDR+, die met computational photography werden samengevoegd in een seconde. Het toestel beschikt daarvoor over een erg krachtige ISP.

Apple’s variant Deep Fusion verschilt van die eerdere pogingen vooral, door het feit dat er een extra foto met lange belichting wordt gemaakt. Deze geeft de neural engine de mogelijkheid om de juiste helderheid in te stellen, vooral bij minder goede lichtomstandigheden. Met Deep Fusion maakt Apple een inhaalslag op Android-fabrikanten, die ook allemaal met computational photography aan de slag zijn gegaan. In ieder geval heeft Apple met de eigen neural engine een belangrijke troef in handen. Maar ook Google zit niet stil: bij elke nieuwe Pixel-telefoon zitten weer nieuwe verbeteringen. Van dit kat-en-muisspel profiteer jij als gebruiker. Fabrikanten doen er alles aan om te zorgen dat jij mooie foto’s kunt maken, zonder erover na te denken. En de benodigde hard- en software wordt de komende tijd alleen nog maar slimmer.

Waarom heb ik Deep Fusion nodig?

Deep Fusion zorgt voor een foto met enorm veel detail, een groter dynamisch bereik en erg weinig ruis. Kortom: de foto ziet er veel beter uit dan je handmatig voor elkaar had gekregen met de best mogelijke camera en lenzen. Het werkt het beste bij matig licht, hoewel het niet speciaal is gemaakt voor foto’s in het donker. Wel is het duidelijk dat Apple met deze functie Google de pas probeert af te snijden. In de Pixel-telefoons is Night Sight een belangrijk verkoopargument en Apple heeft sinds 2019 nachtmodus voor foto’s beschikbaar. Deep Fusion is niet speciaal bedoeld voor nachtfoto’s, maar het komt daarbij wel het best tot z’n recht.

Deep Fusion is erop gebaseerd dat de belichtingstijd voor alle foto’s wordt gevarieerd. De neural engine heeft daardoor voor elke pixel een hoop data om te gebruiken. De neural engine besluit wat het beste contrast is, de juiste mate van scherpte, het juiste dynamische bereik en de juistheid van de kleuren. Al deze factoren en meer worden voor een foto zo optimaal gekozen. De foto’s zien er mooier uit, met meer detail, ook bij slechte lichtomstandigheden. Er is minder ruis te zien en de kleuren komen overeen met de realiteit.

Waarom je Deep Fusion zou gebruiken? Nou, omdat het gewoon mooiere foto’s oplevert!

Taalfout gezien of andere suggestie hoe we dit artikel kunnen verbeteren? Laat het ons weten!