Wat doet de Neural Engine in jouw iPhone, iPad en Mac?

Apple zet al jarenlang in op slimme technieken, zoals computational photography en Deep Fusion. Dit zijn technieken om je foto’s mooier uit de verf te laten komen, zonder dat je er zelf iets voor hoeft te doen. Een speciaal daarvoor ontwikkelde processor voert miljarden berekeningen per seconde uit. Ook op andere gebieden wordt de iPhone gaandeweg steeds slimmer en daarbij hoor je vaak de termen kunstmatige intelligentie (AI) en machine learning. De processor die hiervoor verantwoordelijk is, is de Apple Neural Engine. Op deze pagina vertellen we meer over deze chip, waar we in 2017 voor het eerst over schreven.

- Wat is een Neural Engine?

- In welke toestellen wel?

- In welke toestellen niet?

- Waarom een Neural Engine?

Het gaat in dit artikel om biljoenen berekeningen per seconde, dus geen miljarden of triljoenen. Bij eventuele spraakverwarring over de termen trillion/triljoen, billion/biljoen kun je dit Wikipedia-artikel raadplegen.

Wat is een Neural Engine?

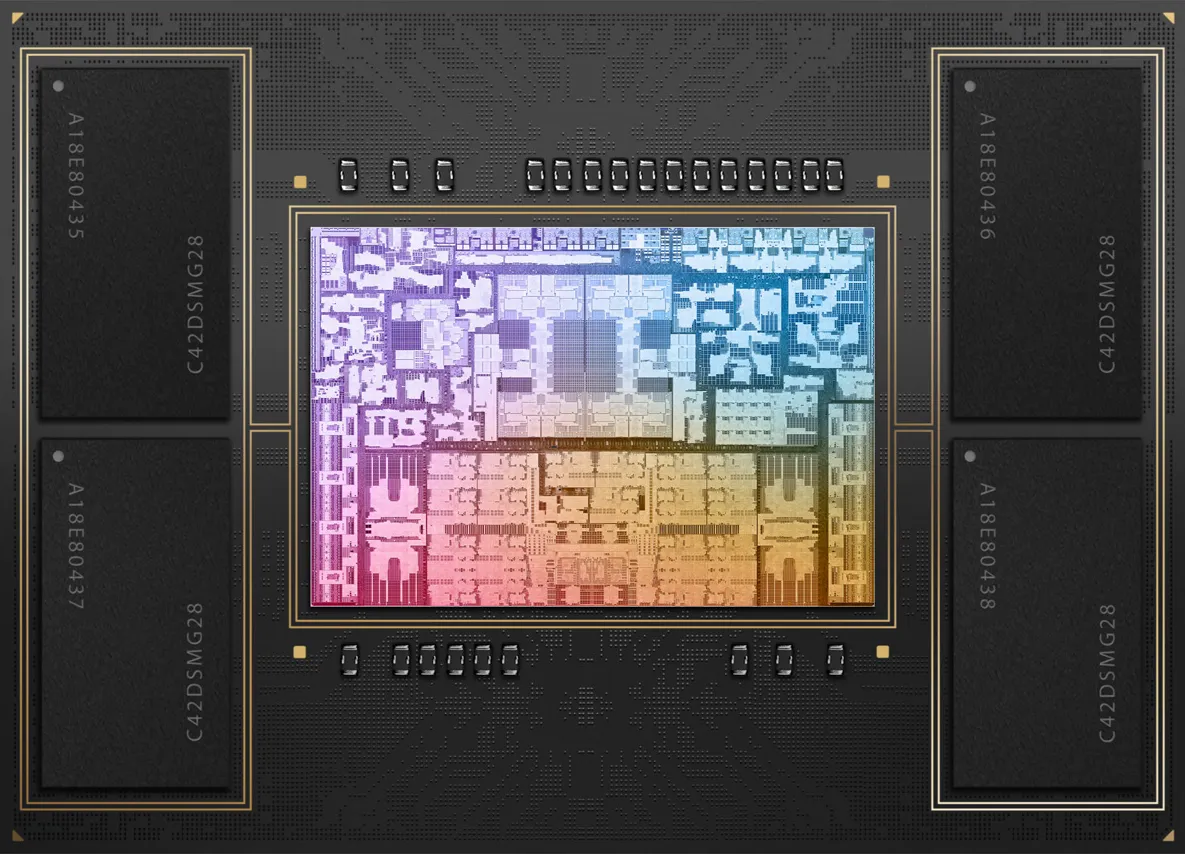

De Apple Neural Engine (ANE) is een Neural Processing Unit (NPU). Dat houdt in, dat het een processor is die ongeveer op dezelfde manier werkt als het menselijk brein en waarbij bepaalde intelligente processen kunnen worden nagebootst. De Neural Engine is vergelijkbaar met een grafische kaart (GPU), maar in plaats van het versnellen van grafische processen versnelt de Neural Engine allerlei rekenkundige bewerkingen die nodig zijn om algoritmes uit te voeren, zoals matrixvermenigvuldigingen. De Neural Engine maakt deel uit van de System on a Chip (SoC) die je in een iPhone vindt. Dit is een pakket met meerdere onderdelen, waaronder de GPU, modemchip voor draadloze verbindingen en de Secure Enclave voor beveiligingsfuncties.

Apple is zeker niet de enige met een Neural Engine. Ook veel andere bedrijven maken hun eigen chips om AI-berekeningen te versnellen. Zo maakt Google de Tensor Processing Unit (TPU), die dezelfde rol vervult in de Google Pixel-smartphones.

In welke toestellen zit een Neural Engine?

Apple introduceerde in 2017 voor het een Neural Engine, als onderdeel van de A11 Bionic-chip in de iPhone 8 en iPhone X. Deze beschikte over 2 neurale kernen en kon 600 miljard berekeningen per seconde uitvoeren. Sindsdien zijn de ontwikkelingen snel gegaan: de A15 Bionic bevat 16 miljoen neurale kernen en kan 15,8 biljoen berekeningen per seconde uitvoeren. En de A17 Pro kan maar liefst 35 biljoen berekeningen per seconde uitvoeren! Ook in de M-chips is een Neural Engine aanwezig, die biljoenen berekeningen per seconde kan uitvoeren. Vanaf de Apple Watch Series 9 en Apple Watch Ultra 2, vind je in deze modellen een 4-core Neural Engine.

In deze devices vind je geen Neural Engine

Apple introduceerde in 2017 de eerste devices met Neural Engine. Toestellen van vóór die tijd (onder andere de iPhone 7-serie) hebben uiteraard geen Neural Engine. Toch zijn sinds 2017 ook nog wel een paar devices verschenen waar geen Neural Engine in zit. Het gaat onder andere om de:

- iPad 6e generatie uit 2018

- iPad 7e generatie uit 2019

- iPod touch 7e generatie uit 2019

- iPad Pro 2017

- Apple TV 4K uit 2017

- Apple Watch (tot en met de Apple Watch Series 8)

- Intel-gebaseerde Macs (alle modellen)

Waarom een Neural Engine?

Toepassingen zoals kunstmatige intelligentie (artificial intelligende) en machine learning worden steeds belangrijker en er zijn talloze mogelijkheden om het te gebruiken: van het maken van mooiere foto’s tot het beter voorspellen van je energieverbruik. Er zijn grote sprongen vooruit geboekt op het gebied van neurale netwerken. Deze proberen met algoritmes het menselijke brein te imiteren. Maar omdat computers niet exact zoals een menselijk brein werken (zaken zoals intuïtie en inlevingsvermogen zijn moeilijk te imiteren) zijn er speciale chips voor gebouwd die zich richten op heel specifieke processen.

Apple bracht in 2017 de Neural Engine uit om deze rekenintensieve bewerkingen op een energiezuiniger manier te kunnen uitvoeren. Het kan worden gebruikt voor video-analyse, spraakherkenning, beeldbewerking en meer. Machine learning zorgt ervoor dat de chip getraind is, zodat latere bewerkingen nog sneller kunnen worden uitgevoerd.

Externe ontwikkelaars kunnen hier ook van profiteren. Aanvankelijk (bij de A11 Bionic) werd de Neural Engine alleen gebruikt voor Apple’s eigen toepassingen zoals Animoji, waarbij digitale karakters jouw gezichtsuitdrukkingen imiteren. Ook wordt het vanaf het begin gebruikt voor snelle gezichtsherkenning met Face ID.

De A12 kon nog ‘maar’ 5 biljoen berekeningen per seconde uitvoeren, terwijl tegenwoordig gemakkelijk 35 biljoen wordt gehaald.

Sinds de introductie van Core ML (een raamwerk voor machine learning) kunnen ook externe ontwikkelaars er gebruik van maken, waarbij ze rechtstreeks de Neural Engine aan het werk kunnen zetten. Het voordeel van een Neural Engine is dat het sneller en efficiënter werkt dan de CPU (hoofdprocessor) en de GPU (grafische chip). Daardoor blijft de iPhone vlot reageren, ook als je ondertussen andere taken aan het uitvoeren bent. De iPhone wordt minder snel oververhit en de batterij gaat minder snel leeg, dan wanneer de CPU en GPU waren ingeschakeld voor deze rekenintensieve taken.

Ben je ontwikkelaar en wil je meer weten over dit onderwerp, raadpleeg dan ook eens deze GitHub-pagina, die regelmatig wordt bijgewerkt met nieuwe info! Wil je een overzicht van alle Apple-chips en -processoren, dan hebben we daarvoor een aparte pagina. Of bekijk wat de Secure Enclave in je iPhone doet.

Taalfout gezien of andere suggestie hoe we dit artikel kunnen verbeteren? Laat het ons weten!