Wat is Private Cloud Compute? Zo beschermt Apple je privacy bij AI-vragen

Met Apple Intelligence zet Apple verdere stappen op het gebied van AI. Voorheen konden we al gebruik maken van allerlei machine learning-functies, maar vanaf iOS 18 pakt Apple flink uit met AI. Allerlei slimme functies worden lokaal op je toestel uitgevoerd en voor complexe taken worden gebruik gemaakt van de cloud. Maar dan wel op een speciale, privacyvriendelijke manier. Hiervoor is Privacy Cloud Compute (PCC) ontwikkeld. Het maakt gebruik van servergebaseerde modellen die draaien op speciale hardware, voorzien van Apple Silicon. Er is zelfs een eigen besturingssysteem voor ontwikkeld.

Private Cloud Compute: dit is Apple’s privacybelofte

Apple belooft dat bij gebruik van de servergebaseerde AI-diensten je privacy wordt beschermd. Dit gebeurt op de volgende manieren:

- Je data wordt nooit opgeslagen

- Het wordt alleen gebruikt voor het afwikkelen van jouw opdrachten

- De privacyfuncties zijn te controleren door externe onderzoekers

Speciale hardware en software voor AI-functies

Apple heeft stilletjes een nieuw besturingssysteem uitgebracht, dat bijna niemand is opgevallen. Dit naamloze besturingssysteem wordt genoemd in een blogposting van Apple. Daarin staat dat er gebruik wordt gemaakt van op maat gemaakte Apple Silicon-computers in combinatie met een gehard besturingssysteem, dat is ontworpen voor privacy. Volgens Apple levert dit de meest geavanceerde beveiligingsarchitectuur op, die ooit is ingezet voor het op grote schaal aanbieden van AI-functies in de cloud. De hardware en software werken daarbij samen. Apple schrijft dat Private Cloud Compute gebruik maakt van speciale compute nodes. Dit is speciale Apple Silicon-gebaseerde serverhardware voor het datacenter. Het gebruikt dezelfde hardwaregebaseerde beveiliging als op de iPhone, zoals Secure Enclave en Secure Boot.

Daarnaast gebruikt Apple een nieuw besturingssysteem. Dit bestaat uit geharde onderdelen van iOS en macOS, die speciaal zijn aangepast om Large Language Modellen (LLM’s) te kunnen gebruiken en maar beperkte mogelijkheden hebben om aangevallen te worden. Momenteel weten we nog niet veel over het nieuwe besturingssysteem, maar dat gaat veranderen. Apple belooft dat bij de introductie van PCC software-images van elke productiebuild van PCC openbaar worden gemaakt, zodat beveiligingsonderzoekers dit kunnen controleren. Elke app en executable is te onderzoeken. “Software wordt binnen 90 dagen gepubliceerd”, belooft Apple.

Wat is Private Cloud Compute (PCC)?

Apple Intelligence nam een groot deel van WWDC 2024 in beslag. Het gaat om een reeks iOS-functies die de kracht van AI laten zien. De meeste functies zullen lokaal worden uitgevoerd, maar voor sommige is verwerking in de cloud nodig om ook complexe functies te kunnen verwerken. Hiervoor is Private Cloud Compute (PCC) ontwikkeld. Dit is een technisch erg interessante aankondiging, al hoef je er als gewone gebruiker niets van te weten.

PCC is een privacygericht systeem voor het verwerken van gebruikersgegevens in de cloud. Dit gebeurt op servers in de cloud (of beter gezegd: nodes). Hoewel mobiele apparaten steeds krachtiger zijn geworden, zijn ze niet tot alles in staat: sommige opdrachten kunnen beter op een krachtige externe computer worden uitgevoerd. Het betekent echter wel dat data moet worden overgedragen en verwerkt en dat brengt risico’s met zich mee.

Bij iMessage en andere berichtenapps wordt hiervoor gebruik gemaakt van end-to-end encryptie. Apple kan deze gegevens tijdens het transport en de verwerking niet zien. Bij AI-functies is dit niet mogelijk, omdat de gegevens bij aankomst op de server leesbaar moeten zijn om ze te kunnen verwerken. Hier komt PCC om de hoek kijken.

PCC is een reeks verifieerbare garanties van Apple, waarmee ze beloven dat er zorgvuldig wordt omgegaan met je gegevens. Apple gebruikt cryptografische methoden om te voorkomen dat gegevens worden opgeslagen, gedeeld of benaderd door iemand anders. Apple heeft zelf ook geen toegang tot de gegevens. Apple probeert op allerlei manieren duidelijk te maken dat de privacybeloftes te controleren zijn.

Hoe werkt Private Cloud Compute?

Private Cloud Compute bestaat uit een reeks cloudservers die gebruikersgegevens verwerken, met een aantal maatregelen om te zorgen dat je privacy blijft gewaarborgd. Je data wordt verwijderd zodra de opdracht is afgerond, dankzij het gebruik van stateless computation. Dit houdt in dat er geen gebruikersgegevens worden bewaard op de cloudnode zodra de opdracht is voltooid.

Een opdracht begint met een activiteit op je iPhone. Daarna worden alleen de gebruikersgegevens klaargezet die nodig zijn om het verzoek te verwerken. Deze gegevens worden versleuteld en beveiligd verzonden naar de node. Geen enkel tussenliggend apparaat heeft toegang tot de gegevens tijdens het transport.

Als de data door de node is verwerkt, wordt het teruggestuurd naar de gebruiker. Zodra dit is gebeurd worden alle gebruikersgegevens op de node verwijderd. De Secure Enclave zorgt ervoor dat alle verzoeken aan het knooppunt veilig worden versleuteld. En er wordt gebruik gemaakt van Secure Boot om te zorgen dat alleen goedgekeurde code op de node kan draaien.

Apple beperkt het risico van aanvallen op allerlei manieren. Zo gelden er strenge maatregelen tijdens de productie van Apple Silicon-hardware en wordt dit na aankomst in het datacenter uitgebreid geverifieerd. Alle nieuwe hardware moet cryptografisch worden geactiveerd door Apple, zodat er geen enkel AI-verzoek kan binnenkomen op een node die niet door Apple is geverifieerd. Is de hardware eenmaal in gebruik, dan wordt de schijfversleutelingscode bij elke herstart op willekeurige wijze vernieuwd door de Secure Enclave. Mochten er nog gebruikersgegeven op de schijf zijn achtergebleven (iets wat onmogelijk zou moeten zijn), dan zijn ze na een herstart niet meer terug te halen.

Dit gebeurt er als je een Apple Intelligence-opdracht geeft:

- De iPhone bepaalt of de opdracht lokaal kan worden uitgevoerd.

- Is er meer rekenkracht nodig, dan wordt de hulp van PCC ingeroepen.

- Alleen data die benodigd is voor het uitvoeren van de taak wordt klaargezet om naar de PCC-servers te versturen.

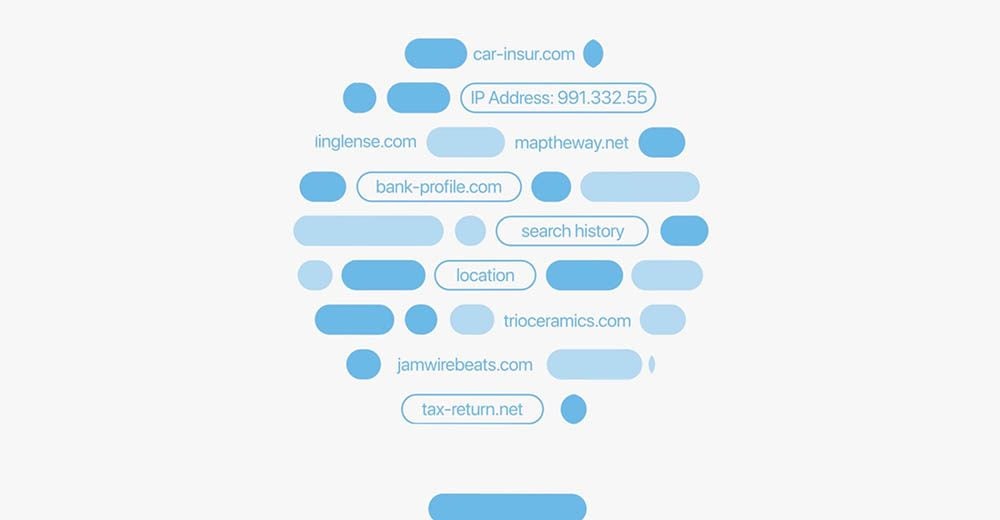

- Het verzoek wordt via een Oblivious HTTP (OHTTP) relay door een externe derde partij verstuurd, zodat het IP-adres van de gebruiker niet te achterhalen is. Dit doet denken aan de al bestaande Private Relay-functie.

- Je data wordt nergens opgeslagen en is niet toegankelijk, ook niet voor Apple.

- Na afloop wordt de data verwijderd. Er wordt dus geen data bewaard, terwijl dit bij andere cloudaanbieders wel zo is.

Ook Apple heeft geen toegang

Er wordt wel eens geklaagd dat Apple’s Siri achterloopt op de concurrentie. Als oorzaak wordt vaak gegeven, dat Apple over minder gebruikersdata beschikt in vergelijking met concurrenten zoals Google en Amazon. Zij kunnen hun klantgegevens gebruiken om de AI-functies uitgebreid te trainen. Zo heeft Meta aangekondigd dat vanaf 26 juni elke post of interactie op Facebook, Instagram, Threads en WhatsApp gebruikt kan worden om de generatieve AI-modellen te trainen. Zelfs als je geen Meta-gebruiker bent kan het bedrijf nog steeds data scrapen, zoals foto’s van jou die door anderen zijn gepost. Dit staat standaard ingeschakeld en je moet nadrukkelijk aangeven dat je hier niet aan meedoet.

Apple kan zoiets niet doen. Het bedrijf belooft strenge privacymaatregelen. Dit betekent ook dat ontwikkelaars ook minder mogelijkheden hebben om bugs en storingen op te lossen en te reageren op incidenten.

Niemand weet welke AI-verzoeken jij verstuurt

Een interessante techniek die Apple toepast om je privacy te verbeteren, is target diffusion. Dit voorkomt dat verzoeken van een specifieke gebruiker naar een specifieke node wordt gestuurd. Een kwaadwillende zou bijvoorbeeld kunnen proberen de AI-opdrachten van een prominente persoon naar een besmette server te gestuurd, om de informatie af te tappen. Dit is op twee manieren vrijwel onmogelijk gemaakt: het is erg moeilijk om een node in Apple’s datacenter te besmetten en door geburik van het eerder genoemde OHTTP-relay is de identiteit van de verzender niet te achterhalen. Een aanvaller zou de controle moeten krijgen over elk element in de infrastructuur van Apple én de externe OHTTP-beheerder om dit voor elkaar te krijgen.

Conclusie: Apple neemt vergaande stappen rond AI-privacy

Apple benadrukt sterk dat je gegevens veilig zijn als je Apple Intelligence gebruikt. En als je kijkt welke maatregelen er zijn genomen, dan gaat Apple veel verder dan andere aanbieders. Zowel op het apparaat zelf als in de cloud zijn allerlei maatregelen genomen om te zorgen dat je privacy gewaarborgd is. Maar dat niet alleen: Apple publiceert ook de broncode van vrijwel alle software die ze op de servers gebruiken, zodat dit geïnspecteerd kan worden door externe partijen. Dit is ongekend voor aanbieders van AI-diensten: geen enkele aanbieder heeft publiekelijk verifieerbare cloudsoftware. Apple doet dit wel, maar het zal vooral indruk maken op techneuten. De vraag is of het algemene publiek ook ziet hoeveel vergaande maatregelen Apple heeft genomen in vergelijking met anderen.

Ben je zo’n techneut, dan vind je hier meer informatie bij Apple:

Voor niet-techneuten is er:

- Apple-persbericht over privacy (of lees ons overzicht van privacy in iOS 18)

Taalfout gezien of andere suggestie hoe we dit artikel kunnen verbeteren? Laat het ons weten!

Apple Intelligence en AI van Apple

Apple Intelligence is het nieuwe AI-systeem van Apple. AI staat voor kunstmatige intelligentie, maar heeft dankzij Apple Intelligence ook een andere betekenis gekregen. Apple omschrijft het als de meest persoonlijke vorm van AI, doordat het grootste deel lokaal gebeurt en het systeem weet wie jij bent en wat voor jou belangrijk is. Met Apple Intelligence kun je afbeeldingen genereren, werkt Siri veel beter, kun je teksten laten samenvatten of maken en nog veel meer. Apple Intelligence komt in het najaar van 2024 als beta beschikbaar in het Engels in iOS 18, iPadOS 18 en macOS Sequoia.